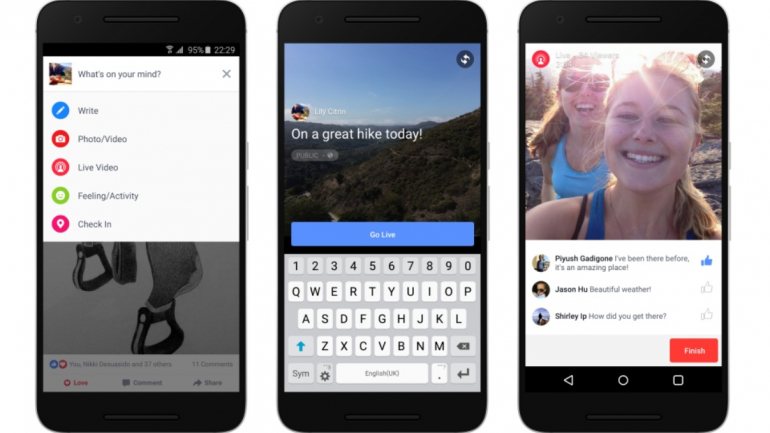

O Facebook vai impor mais restrições para quem faz vídeo em direto– os lives, em inglês — na rede social. A partir de agora, quem não cumprir as regras vai ser suspenso de continuar a utilizar a ferramenta da rede social, além de ver o vídeo retirado. A medida foi anunciada em comunicado pela empresa no seguimento de mudanças prometidas depois de, a 15 de março, a plataforma ter sido utilizada pelo terrorista que atacou duas mesquitas na Nova Zelândia e matou 51 pessoas.

Até esta semana, o Facebook apagava os vídeos publicados e, no máximo, bania ou suspendia o utilizador da plataforma. Com esta alteração, que impõe um regra de “infração única” aos utilizadores — basta não cumprir um dos requisitos para ter a sanção da rede social –, mesmo quem não seja banido do Facebook deixa de poder utilizar os lives.

Após os terríveis ataques terroristas [na Nova Zelândia], analisámos o que podíamos fazer para impedir que os nossos serviços sejam utilizados para causar danos ou promover o ódio”, escreveu Guy Rosen, vice-presidente de integridade do Facebook.

“Para já”, esta nova regra não vai ser aplicada nos vídeos em direto no Instagram, também detido pelo Facebook, diz a empresa. Contudo, as novas regras da rede social principal da empresa já estão em vigor e, num futuro próximo, vão criar também restrições a todo o tipo de usuários, mesmo quem utilize a plataforma apenas para fazer anúncios.

A medida surge depois de o Facebook ter assumido em março que o sistema de filtragem “não é perfeito” e ter retirado 1,5 milhões vídeos do ataque a Christchurch.

Ao anunciar esta nova mudança às regras, o Facebook afirmou ainda que vai investir 7,5 milhões de dólares (cerca de 6,6 milhões de euros) numa parceria com duas universidades: Cornell e Berkeley. Este investimento vai ser aplicado na investigação de novos recursos que possam melhorar os sistemas de filtragem do Facebook para impedir a disseminação de vídeo terroristas ou imagens manipuladas para influenciar os utilizadores com propósitos nefastos.