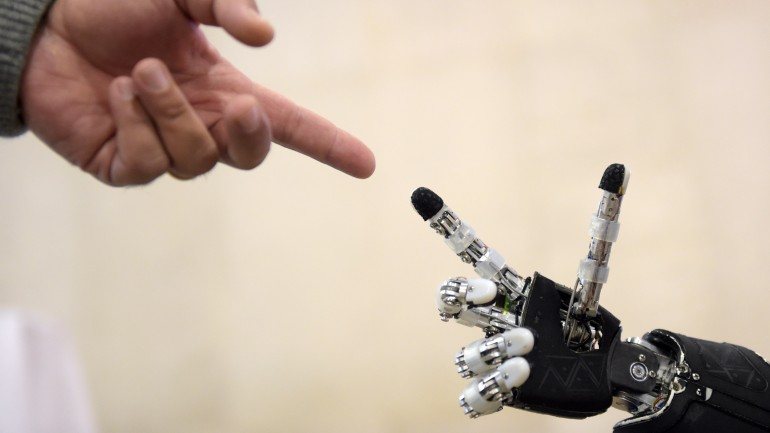

Robots munidos com armas, sejam eles caminhantes ou voadores, sim ou não? Eis a questão que, na segunda-feira, começou a dividir os líderes dos países reunidos na Convenção sobre Certas Armas Convencionais (CAC) da ONU, que se realiza até sexta-feira em Genebra, na Suíça, pois nem toda a gente pretende que se coloque um travão no desenvolvimento de Sistemas Autónomos de Armamento Letal (Laws, na sigla inglesa). Ou seja, há países a quererem prosseguir o desenvolvimento de armamento que não requeira a intervenção direta de um humano.

Um deles é o Reino Unido que, de momento, “não vê qualquer necessidade de proibir a utilização de Laws”, pois a “lei humanitária internacional já prevê regulação suficiente nesta área”. A justificação chegou através de um porta-voz do Ministério dos Negócios Estrangeiros, citado pelo The Guardian, que ainda garantiu que o território “não está a desenvolver armas autónomas letais” e “haverá sempre supervisão humana sobre os sistemas de armamento” britânicos.

A convenção reúne políticos, peritos em armamento, engenheiros, advogados, cientista e representantes de organizações de direitos humanos.

Mas, afinal, o que são Sistemas Autónomos de Armamento Letal? São drones, por exemplo, e também pode ser robots controlados à distância, ou sistemas de artilharia antiaérea, como a Cúpula de Ferro (Iron Dome), criada por Israel para detetar e intercetar automaticamente mísseis num raio de 250 quilómetros. Um dos objetivos da convenção das Nações Unidas é chegar a um consenso para criar uma definição concreta do que tipo de armas que possam ser consideradas como Laws.

Depois existem as perguntas éticas: A dependência em robots e sistemas autónomos na sociedade contribuiu para a sua aceitação em cenários militares? A capacidade das Laws protegerem vidas humanas em conflitos armados tornaria a sua utilização eticamente aceitável? Como é que uma máquina sem emoções humanas seria útil numa situação de combate? E é aceitável que uma máquina tenha poder de decisão sobre a vida de um humano? Estas, e muitas outras, são abordadas na convenção liderada por Michael Biontino, representante alemão.

O debate justifica-se pois, como sublinhou Peter Asaro, vice-presidente do Comité Internacional para o Controlo de Armas Robóticas, ao diário El Mundo, “a tecnologia para fabricar este tipo de armamento já existe, e não o desenvolver depende da vontade dos países e exércitos”. Jody Williams, vencedora do Prémio Nobel da Paz em 1997, defendeu ao mesmo jornal que “já é tempo de falar sobre este tema e tomar medidas”. Pascoal Campoy, professor do Centro de Robótica da Universidade Politécnica de Madrid, explicou que hoje “já é possível desenvolver um programa [informático] que tome decisões em função de dados que lhe sejam dados”. A pergunta é, prossegue, “qual é o critério que se dá à máquina e, sobretudo, quantos e quais dados lhe são fornecidos”.

Depois existem as vozes e entidades que são contra a utilização e desenvolvimento deste tipo de armamento. “Deveria ser óbvio que qualquer arma deve permanecer sob o controlo humano”, defendeu Thomas Nash, cofundador da Stop Killer Robots (Acabem com os Robots Assassinos, em tradução literal), antes de realçar que “qualquer ataque militar devia passar pela deliberação humana”. Caso não o seja, o especialista teme que “a próxima fase seja permitir que seja a própria máquina a [tomar a decisão de] iniciar um ataque”.