Índice

Índice

Já é vista como a primeira grande batalha legal no mundo dos media devido à inteligência artificial (IA) generativa. De um lado do ringue, o New York Times (NYT), uma das referências internacionais do jornalismo também referida como “gray lady”. Do outro, a parceria de peso que junta a OpenAI, a criadora do ChatGPT, e a Microsoft, uma das maiores tecnológicas do mundo. Tudo por uma disputa centrada nos direitos de autor. O jornal considera que deve receber “milhares de milhões de dólares” pela forma como as suas notícias e reportagens, protegidas por direitos de autor, foram usadas sem autorização para o desenvolvimento do ChatGPT e outros serviços com IA.

A queixa do NYT foi apresentada quase no fim de 2023. Ao longo de 69 páginas argumenta-se que as notícias, reportagens e investigações produzidas ao longo de décadas estão agora a ser reproduzidas por um grande modelo de linguagem (LLM, na sigla em inglês), praticamente palavra por palavra, sem qualquer tipo de compensação financeira. O jornal, um dos mais relevantes na cultura anglo-saxónica, puxa dos galões e diz que os prémios que recebeu ao longo dos anos existem devido a um “investimento massivo” de milhões de dólares no jornalismo. Investimento que, aos olhos do jornal, está a ser usado de forma indevida pela OpenAI e Microsoft para desenvolverem produtos que lhes garantem receitas na ordem dos milhões de dólares.

O jornal argumenta que o desenvolvimento de LLM tem sido “extremamente lucrativo” para as duas tecnológicas. “(…) Ajudou a Microsoft a impulsionar o seu valor de mercado em um bilião de dólares só no último ano”, enquanto o “lançamento do ChatGPT levou a avaliação da OpenAI a crescer até 90 mil milhões de dólares”. Existe uma estreita ligação entre a startup de IA e a Microsoft, que investiu pelo menos 13 mil milhões de dólares na OpenAI. É dito pelo jornal que os interesses de negócio de IA generativa das duas empresas estão “profundamente ligados”.

Os magistrados do tribunal de Nova Iorque, onde entrou a ação, não vão ter apenas quase 70 páginas de queixa para ler: num dos anexos, os advogados do NYT incluíram 100 exemplos de como o ChatGPT não só estava a reproduzir palavra a palavra textos do jornal como até dava uma ajuda a ultrapassar paywalls – bastava pedir ao chatbot mais parágrafos de um determinado texto.

O caso já está a ser visto como o “momento Napster” da OpenAI, uma referência a um dos processo mais conhecido de pirataria musical no início do milénio. Mas há quem prefira olhar para as diferenças. “O Napster competia a 100% com os produtos existentes: gravava-se um CD que depois era possível encontrar de borla no Napster. O que os sistemas de IA generativa fazem não é a mesma coisa”, considera Kristian Stout, do International Center for Law & Economics (ICLE). “O tipo de ameaça que representam não é necessariamente uma destruição do modelo de negócio [do NYT], mas é algo que implica adaptação”, admite.

Pelo relevo das entidades envolvidas, o caso do NYT contra as tecnológicas rapidamente passou a ser visto não só como uma batalha pelos direitos de autor, mas também como uma chamada de atenção para o futuro do jornalismo num mundo onde a IA ganha cada vez mais relevância. “Se o Times e outras organizações noticiosas não conseguem produzir e proteger o seu jornalismo independente, haverá um vácuo que nenhum computador ou IA poderá preencher”, alerta o jornal.

The Times alega que estão em risco receitas e a sua própria reputação

Para se treinar um grande modelo de linguagem, como é o caso do ChatGPT, é preciso uma enorme quantidade de conteúdos, como texto e imagens. O NYT argumenta que foram usados “milhões” dos seus dados, sem autorização ou compensação, para o treino das ferramentas desenvolvidas pela OpenAI, que atualmente têm um peso relevante na estratégia de IA da Microsoft.

O jornal considera que foi dada uma “ênfase particular” ao conteúdo do NYT na criação dos modelos de linguagem, “revelando uma preferência que reconhece o valor destes trabalhos”. As duas empresas são acusadas de, conscientemente, tirar partido do “investimento massivo” do jornal ao usar conteúdos protegidos por direitos de autor para desenvolver serviços que ameaçam o modelo de negócio da publicação.

A linha temporal descrita na queixa revela que o NYT abordou as empresas em abril de 2023 devido às “preocupações com a propriedade intelectual”, quando percebeu que serviços como o ChatGPT estavam a “recitar conteúdo”, a resumir peças e até a “imitar o seu estilo expressivo”. O NYT alega que o ChatGPT e outros serviços com IA, como o Copilot, “memorizaram” informação e que estão agora a reproduzi-la, palavra por palavra, para os utilizadores.

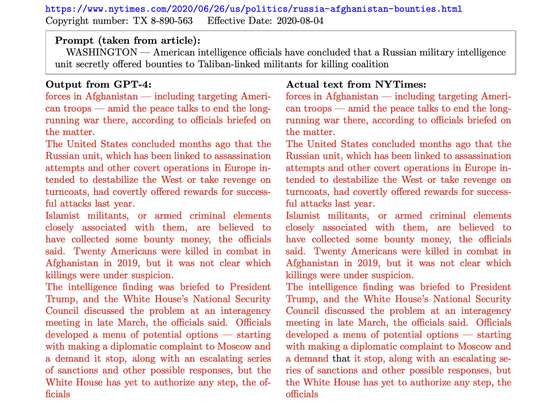

Há um documento complementar à queixa em que são documentados 100 exemplos de como o ChatGPT terá apresentado a mesma informação que os artigos do NYT. É divulgado o texto original, o pedido (prompt) feito pelo utilizador ao GPT-4 (apenas disponível na versão paga) e a informação apresentada.

Um de cem exemplos compilados pelo New York Times. A vermelho, foram assinaladas as mesmas palavras que são usadas no resultado do ChatGPT e no texto do NYT

Assinalado a vermelho está a informação que o ChatGPT usou dos artigos do jornal. Em muitos dos exemplos, os resultados são grandes manchas de texto vermelhas. Num dos testes feitos pelo Observador, recorrendo à versão gratuita do ChatGPT (GPT-3,5), o resultado não é o mesmo que está documentado na queixa. Usando o mesmo prompt, um excerto de um texto do NYT sobre uma investigação do jornal, o chatbot identifica que “parece estar relacionado com uma investigação de 2020” e apresenta um resumo da informação e a fonte. Pedindo o primeiro parágrafo, fica o alerta de que “as palavras exatas podem variar consoante a fonte específica” do artigo. No teste do NYT, o resultado do ChatGPT é maioritariamente igual ao que está na notícia.

Em outro dos testes feito pelo Observador, a versão gratuita do ChatGPT respondeu que “não pode apresentar excertos de textos protegidos por direitos de autor”, mas que “pode oferecer um sumário ou discutir aspetos específicos” do texto.

Ao longo das páginas de informação, o NYT deixa claro que teme que, com os resumos do ChatGPT ou do Bing, os utilizadores deixem de ter um incentivo para visitar o site. E, com menos visitas, será de esperar “um impacto nas receitas de publicidade e subscrições”.

Além dos direitos de autor, o NYT considera que as “alucinações” da IA, os casos em que os modelos apresentam informação que poderia ser plausível no contexto mas que não é verdadeira – em linhas gerais, quando o modelo não sabe a informação “inventa” –, atribuem erradamente informação ao jornal. Nesse sentido, considera que estão a ser causados “danos comerciais e concorrenciais ao atribuir incorretamente conteúdo ao The Times”. “Em discurso de IA, isto chama-se ‘alucinação’. Em inglês simples, é desinformação”, continua a queixa.

Até agora, só a OpenAI é que se pronunciou sobre o mediático processo. “Respeitamos os direitos dos criadores de conteúdo e donos e estamos comprometidos em trabalhar com eles para garantir que beneficiam da tecnologia de IA e de novos modelos de receitas”, diz, numa declaração divulgada por fonte oficial da startup em reação ao processo. No entanto, a OpenAI acrescenta ter ficado “surpreendida e desapontada” com o facto de o NYT ter recorrido à justiça, descrevendo as “conversações em curso” como “produtivas”, dizendo que estavam “a avançar de forma construtiva”. “Temos esperança de que encontraremos um modelo que beneficia mutuamente uma forma de trabalharmos juntos, como temos feito com muitos outros ‘publishers’.”

Ao contrário da OpenAI, a Microsoft tem optado pelo silêncio. Desde que a queixa foi apresentada, a 27 de dezembro, a dona do Windows não fez comentários sobre o processo. O Observador contactou a empresa e recebeu a informação de que não iria fazer comentários.

Glossário: os conceitos e siglas mais frequentes no “boom” da inteligência artificial

↓ Mostrar

↑ Esconder

IA generativa: é o que está atualmente a concentrar as atenções no mundo da IA e consegue gerar informação a pedido dos utilizadores. O ChatGPT é capaz de produzir IA generativa – ou seja, gerar texto ou responder a pedidos dos utilizadores. Noutros serviços a IA consegue gerar imagens (Dall-E, Midjourney) ou até áudio (a Meta tem o Audiocraft e o Voicebox).

LLM: a sigla em inglês para large language models, em português grandes modelos de linguagem. São modelos de IA alimentados por uma grande quantidade de dados, que conseguem compreender, interpretar e processar linguagem natural. O ChatGPT ou o Bard, por exemplo, são exemplos de serviços que funcionam graças a um LLM.

Linguagem natural: normalmente é usada a expressão processamento de linguagem natural (PLN). É uma parte da ciência da computação e é um conceito fundamental para assegurar que há praticidade na interação entre humanos e máquinas. Só quando as máquinas passaram a conseguir compreender linguagem natural de uma forma mais satisfatória é que se tornou mais agradável interagir com chatbots.

Chatbot: a designação dada a um serviço onde há uma interação entre humano e máquina, normalmente através de texto. Podem ser considerados exemplos de chatbot o ChatGPT ou o Bard, por exemplo.

GPT: é a sigla para Generative Pre-trained Transformer, uma forma avançada de tecnologia de IA. É o que consegue gerar texto que se assemelha à escrita humana a partir da informação que recebe do utilizador. Os diferentes modelos da OpenAI adotaram a designação GPT, acompanhados de números consoante a versão (GPT-3.5, GPT-4).

Alucinações: no caso dos modelos LLM, a IA dá sugestões da palavra seguinte que é provável de aparecer em determinados contextos, comparando com a informação com que foi treinado. Por exemplo, se receber uma pergunta sobre um Elvis, o modelo poderá ter tendência a sugerir o apelido mais provável para esse nome, Presley. É o que explica, em parte, o fenómeno das “alucinações” da IA, casos em que o modelo até pode não saber a informação verdadeira, mas sugere o que seja provável em alguns contextos, mesmo que não seja a resposta correta.

Prompt: é a informação ou o pedido que é apresentado pelo utilizador ao serviço de IA com que está a interagir. Por exemplo, “dá-me sugestões de um roteiro de viagem de cinco dias a Marrocos, dividido por dias” é um “prompt”.

Caso poderá abrir precedentes nos EUA e ditar desfecho noutras situações

Na queixa fica claro que o NYT e as duas empresas tentaram negociar ao longo de meses, mas sem chegar a um acordo. Dias depois da ação entrar em tribunal, o jornal escreveu que o preço do acordo de licenciamento terá sido o ponto de discórdia. Também terão estado em negociações com a OpenAI a Gannett, a maior empresa de jornais dos EUA, a News Corp, dona do Wall Street Journal, a IAC, responsável pelo Daily Beast, e a Dotdash Meredith.

Os especialistas de propriedade intelectual ouvidos pelo Observador reconhecem que o caso, devido à dimensão dos envolvidos, é uma batalha legal que poderá mudar a forma como os direitos de autor convivem com a IA. Lídia Neves, advogada e responsável pela área de propriedade intelectual da Antas da Cunha ECIJA, admite a possibilidade de o recurso à justiça ter sido feito como uma espécie de pressão pública ou por “não terem chegado a um acordo sobre o valor” de licenciamento.

“Os argumentos do NYT são fortes”, diz por sua vez Sílvia Cristóvão, associada coordenadora das áreas de propriedade intelectual, direitos de autor, propriedade industrial e proteção de dados da Pares Advogados, já que “no fundo, ‘ensina-se’ a IA com os conteúdos” do jornal, sem que o “NYT participe nos lucros dos ‘gigantes tecnológicos”.

Tanto Lídia Neves como Sílvia Cristóvão consideram que o processo tem potencial para criar precedentes e jurisprudência nos EUA, onde as sentenças têm em conta decisões que foram tomadas noutros casos. “No que diz respeito aos EUA, pode determinar um precedente pelo qual se julgarão futuras ações”, diz Sílvia Cristóvão. E, se o “caso for julgado a favor dos gigantes da IA, constituirá um precedente não desejável para os media”.

“A grande discussão está em como definir os direitos de autor sobre aquela obra que é criada por via da IA, uma vez que são usados conteúdos de vários terceiros”, complementa Lídia Neves, da Antas da Cunha ECIJA. A especialista considera que “tem de haver regulação e jurisprudência” no tema da IA generativa “o mais rapidamente possível”. Neste caso do NYT, parece-lhe ser “uma questão bastante líquida que houve cópia parcial ou integral de textos”, pelo que “há uma violação de direitos de autor”.

▲ O ChatGPT foi lançado em novembro de 2022. De acordo com os números mais recentes, tem 100 milhões de utilizadores por semana

WU HAO/EPA

Empresas recorrem ao argumento de “uso justo” e “propósito transformador”. É suficiente?

Na queixa, o jornal argumenta que a OpenAI e a Microsoft insistiram na ideia de que estariam protegidas por uma lógica de “uso justo”, uma vez que recorreram a conteúdos alheios para um “propósito transformador”. O argumento é contestado pelo jornal.

Para alguns especialistas, o tema do uso justo é uma “questão aberta” e até “mais complexa” do que as tecnológicas estão a tentar transmitir. “Represento uma minoria, mas tenho tendência a pensar que o uso justo não é um dado tão adquirido quanto a OpenAI e a Microsoft acham que é”, explica ao Observador Kristian Stout, diretor de políticas de inovação do International Center for Law & Economics (ICLE).

“O argumento das empresas é que treinar um sistema de IA conta como um uso transformador, no âmbito de um uso justo nos EUA”, contextualiza. Esta figura jurídica prevê algumas exceções que não são vistas como infrações aos direitos de autor, como a utilização para fins de educação e investigação. E, na lógica da OpenAI, há um efeito transformador, já que o produto final, em teoria, não é igual ao original.

“A questão é: o uso justo vai ter de ser julgado por um júri e há uma série de fatores que vão ser ponderados”, lembra Stout, nomeadamente o fator humano que deverá estar presente numa questão “ambígua” como esta. “Isto vai ser colocado a um grupo de humanos que também vão ponderar outras coisas”, incluindo o potencial que os modelos de IA já apresentaram. “Será que não vão estar a pensar [nas consequências] de desligar esta tecnologia, que poderia ser muito útil? Alguns jurados provavelmente estarão, pelo menos de forma inconsciente, inclinados a pensar que existe um uso transformador. “

Stout considera que existem alguns cenários possíveis para o desfecho do processo. Um deles, “mais provável”, poderá passar pelo próprio tribunal “estipular um montante a pagar ao NYT”. Porém, num cenário em que surjam “vários casos destes, apresentados em tribunais diferentes, e que sigam direções distintas”, a solução seria outra — avançar para o Supremo Tribunal ou para o Congresso resultando “nalguma mudança na lei de direitos de autor dos EUA”, admite o especialista norte-americano. O processo arrastar-se-ia durante algum tempo, possivelmente anos.

De qualquer forma, pela sua experiência, Stout refere que o acordo entre as partes, ainda antes da decisão em tribunal, parece “totalmente possível, mas que pode tornar as coisas mais caras”. E, mesmo assim, não ajudaria a compreender se houve uso justo ou não. “Independentemente de quão forte o NYT pensa que é o seu caso, existe a possibilidade de enfrentar um júri que gosta muito de IA e, aí, estão arrumados — o júri pode fazer o que quiser”, teoriza. “Se chegarem a um acordo, isso pode acontecer este ano e o caso desaparece, mas ficamos num limbo sem saber se é uso justo ou não.”

Na ação o jornal norte-americano pede que as empresas destruam os modelos que foram desenvolvidos com conteúdos que não foram licenciados. Essa é a hipótese que, aos olhos do especialista do ICLE, parece menos provável. “Não vejo muitos juízes ou legisladores a quererem destruir completamente a indústria e a dizer ‘ok, este produto que toda a gente está a usar vai ter de destruir e apagar todos os modelos que provaram ser úteis’.”

Setor dos media em Portugal está atento, mas aguarda por lei da IA antes de agir

O processo do NYT está a ser acompanhado com atenção pelo setor dos media em Portugal. Cláudia Maia, presidente da Associação Portugal de Imprensa (APImprensa), explica ao Observador que, até ao momento, “não houve qualquer pedido em Portugal para utilizar conteúdos” de meios de comunicação portugueses para o treino de ferramentas de IA. “E é algo que tem de acontecer”, lembra, frisando que os editores portugueses têm de ser recompensados quando há uma utilização deste género.

Ainda assim, não houve contacto por parte dos mais de 450 associados, entre meios de comunicação social de âmbito nacional, regional e especializado, com “questões como a do NYT”. “Da parte da imprensa e associados, acho que os editores portugueses ainda não estão perfeitamente alerta para o que aí vem, porque estão submergidos noutra preocupações e a tentar chegar ao final do mês”, diz a presidente, que assumiu a liderança da APImprensa em julho.

Cláudia Maia explica que a associação está de “mãos dadas” com a Visapress, a entidade que faz a gestão coletiva do direito de autor de obras ou conteúdos jornalísticos publicados em jornais e revistas em Portugal, nas negociações com as plataformas tecnológicas. Tem sido também feito um esforço para participar em fóruns e organizações internacionais do setor, onde já são discutidos os efeitos da IA, principalmente a generativa, para o mundo da imprensa. Mas reconhece que a IA “ainda é um mundo por explorar e muito novo para todos”.

Do lado da Visapress, Carlos Eugénio, diretor executivo, confirma que não houve contacto por parte das grandes plataformas para discutir acordos de licenciamento em Portugal. Algo que, aos olhos deste porta-voz, até devia ser feito “proativamente” por estas empresas. “Estamos atentos em Portugal, sabemos que os algoritmos de IA, não só da Microsoft, mas também da Google e OpenAI, estão a usar conteúdo que está livremente disponível na internet sem estarem autorizados pelos titulares de direito a fazê-lo.”

Carlos Eugénio considera que há “algumas questões legais” pendentes na Europa, como a finalização da legislação da IA, que colocam “alguma acalmia e alguma pausa” nas possíveis ações para responsabilizar os responsáveis por modelos de IA. “Não queremos ir por um caminho que depois pode ser completamente gorado, temos de ter alguma certeza do que vai ser a legislação no futuro”, explica este responsável. “Se o que for decidido em Bruxelas, que ainda não está totalmente fechado, relativamente ao regulamento da IA, nos apontar um caminho diferente, logo teremos de avaliar o que vamos fazer.”

Aos olhos do diretor executivo da Visapress, é justamente a existência de “alguma incerteza naquilo que podem ser os direitos dos editores de imprensa” na IA que faz com que ainda não tenha havido ações semelhantes às do jornal norte-americano. “Na Europa, ainda não há ninguém que tenha feito qualquer tipo de ação, tanto quanto sei, contra qualquer tipo de plataforma que utilize os seus conteúdos para alimentar os algoritmos de IA”.

Deste lado do Atlântico, Carlos Eugénio diz que acompanha “de forma positiva” o que está a ser feito nos EUA, nomeadamente este caso do NYT. “Acho que o primeiro passo tinha de ser dado.”

▲ A OpenAI e a Microsoft têm uma parceria na IA. A tecnológia liderada por Satya Nadella é a principal investidora da criadora do ChatGPT

Getty Images

Os acordos de licenciamento que a OpenAI já assinou

O New York Times e as duas empresas podem não ter chegado a um acordo nos últimos meses, mas há nomes relevantes do mundo dos media com acordos de licenciamento assinados com a OpenAI.

Em julho, a dona do ChatGPT e a Associated Press (AP) anunciaram um acordo para que a empresa de IA pudesse ter acesso aos arquivos de notícias da agência. “O acordo prevê que a OpenAI possa licenciar parte do arquivo de texto da AP, enquanto a AP vai tirar partido da tecnologia e especialização de produto da OpenAI”, foi divulgado num comunicado conjunto.

Até agora, não são conhecidos os valores envolvidos nestas negociações, que implicam o acesso da OpenAI ao arquivo de notícias da AP até 1985. Está ainda em cima da mesa o possível desenvolvimento “de usos para a IA generativa em produtos noticiosos e serviços”, mas sem avançar mais pormenores. Ainda assim, a AP salientou que atualmente não usa IA generativa nas suas notícias, mas que há já quase “uma década” que usa tecnologia para aliviar o trabalho nas análises de resultados de empresas ou a recuperar alguns momentos de competições desportivas. E, recentemente, foi lançada uma pesquisa de imagens otimizada por IA.

Além da AP, a OpenAI fechou recentemente um acordo de licenciamento de conteúdos com o grupo Axel Springer, que detém o jornal alemão Bild ou sites como o Politico e a Business Insider. Segundo o NYT, que cita fontes com conhecimento do assunto, o acordo envolve o pagamento por parte da OpenAI de 10 milhões de dólares anuais pelo uso de conteúdos do grupo Axel Springer.

Da arte à literatura, há mais processos devido à IA

O lançamento do ChatGPT mudou muita coisa no espaço de um ano. De repente, milhões de pessoas puderam interagir com um site em que bastava pedir para ter acesso a uma peça de teatro escrita ao jeito de William Shakespeare. Diz a expressão que a imitação pode ser a forma mais sincera de elogio mas vários artistas, da música à literatura, não têm escondido o descontentamento de haver tecnologia que consegue imitá-los e usar o seu trabalho sem qualquer compensação. O processo do NYT está longe de ser a única batalha legal que envolve a OpenAI.

No ano passado, mais de 15 mil escritores, incluindo autores de bestsellers como Margaret Atwood, Nora Roberts ou Dan Brown, uniram-se para criticar a forma como as suas obras foram usadas para treinar modelos que conseguem replicar o seu tom de escrita. Numa carta aberta endereçada aos líderes das tecnológicas, alertaram para a “injustiça da exploração” dos seus trabalhos pelos sistemas de IA, sem qualquer tipo de “consentimento, créditos ou compensação”. “Estão a gastar milhares de milhões de dólares para desenvolver tecnologia de IA. É apenas justo que nos compensem pelo uso da nossa escrita, sem a qual a IA seria banal e extremamente limitada”, lê-se na carta.

Além desta missiva, que foi enviada aos líderes da OpenAI, Alphabet, Meta, Stability AI, IBM e Microsoft, também foram escritos artigos de opinião com queixas sobre o uso indevido de material protegido. Num artigo para a revista The Atlantic, Margaret Atwood, que escreveu a distopia “A História de uma Serva”, questionou se estaria a ser “assassinada” pela sua réplica quando percebeu que 30 dos seus livros foram usados para treinar a IA. “Para tornar a questão mais insultuosa, o bot está a ser treinado com cópias pirateadas dos meus livros. A sério! Quão ridículo é isto? Estas empresas morreriam se tivessem de pagar o mísero valor de 33 livros? Querem fazer muito dinheiro à custa das entidades que foram criadas e engordadas com as minhas palavras, por isso ao menos paguem-me um café”, escreveu a canadiana.

Até que as queixas evoluíram para os tribunais. Em setembro, um grupo de escritores, que incluiu nomes como John Grisham e George R.R. Martin, o autor d”A Guerra dos Tronos”, avançaram com um processo em Manhattan contra a OpenAI pelo uso indevido de material protegido para treinar o ChatGPT. Antes disso, a comediante norte-americana Sarah Silverman tinha lançado um processo contra a empresa de Sam Altman e também contra a Meta, devido ao uso do seu livro para treino de modelos de linguagem. No processo, estiveram ainda envolvidos nomes como Christopher Golden e Richard Kadrey.

A IA está longe de produzir apenas texto – há vários exemplos de modelos que conseguem gerar imagens a pedido de utilizadores. No início de 2023, a gigante de imagens de stock e fotografia, processou a Stability AI, a criadora do gerador de imagens Stable Diffusion. A Getty recorreu à justiça americana para contestar o uso de mais de 12 milhões de imagens, sem permissão ou compensação, que foram usadas para treinar a tecnologia que consegue produzir imagens a pedido dos utilizadores.

Outro dos processos, que além da Stability AI envolve a Midjourney, DeviantArt e Runway AI, foi interposto pelas ilustradoras Sarah Anderson, Kelly McKernan e Karla Ortiz pelo uso indevido de obras de milhares de artistas para treinar os modelos de IA. Foi recentemente divulgada a lista de artistas cujo trabalho foi usado e há portugueses na lista: Add Fuel (Diogo Machado), Jorge Jacinto, Nadir Afonso, Regina Pessoa e Vhils (Alexandre Farto).

Artistas portugueses na lista de provas em processo contra serviços de IA nos EUA