A Google não quer perder o passo na corrida para liderar a inteligência artificial (IA). Dos laboratórios da DeepMind, a startup que adquiriu em 2014 por 400 milhões de dólares, saiu o Gemini, o novo modelo de IA multimodal, ou seja, construído para generalizar e compreender diferentes tipos de informação, seja em texto, imagem, áudio, vídeo ou código.

Na lista de argumentos para dizer que está mais à frente do que as rivais, a Google diz que o Gemini demonstrou “um desempenho de última geração em muitos benchmarks líderes”, explica Sundar Pichai, CEO da Google, em comunicado. O líder da tecnológica frisa que estão “apenas a começar a ‘arranhar’ a superfície daquilo que é possível” fazer na inteligência artificial.

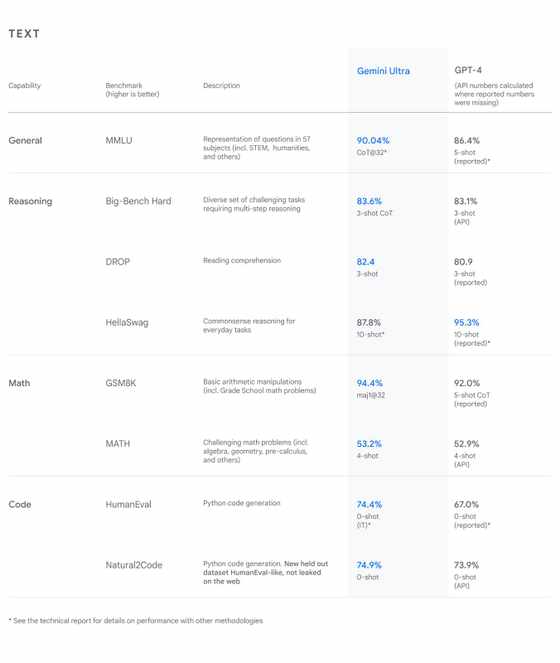

De acordo com a Google, o Gemini “excedeu os resultados atuais” de última geração em “30 dos 32” critérios usados na investigação e desenvolvimento de grandes modelos de linguagem (LLM, na sigla em inglês). Nestes parâmetros, estão incluídas questões como a compreensão natural do que está em imagens, raciocínio matemático e compreensão de áudio e vídeo. O rival da OpenAI, que alimenta o ChatGPT, tem revelado algumas dificuldades no raciocínio matemático, por exemplo.

“Com uma pontuação de 90,04%, o Gemini Ultra é o primeiro modelo a superar os especialistas humanos em MMLU (compreensão massiva de linguagem multitarefa), que usa uma combinação de 57 disciplinas como a matemática, física, história, direito, medicina e ética para testar o conhecimento do mundo e a capacidade de resolução de problemas”, detalha Demis Hassabis, CEO e co-fundador da DeepMind.

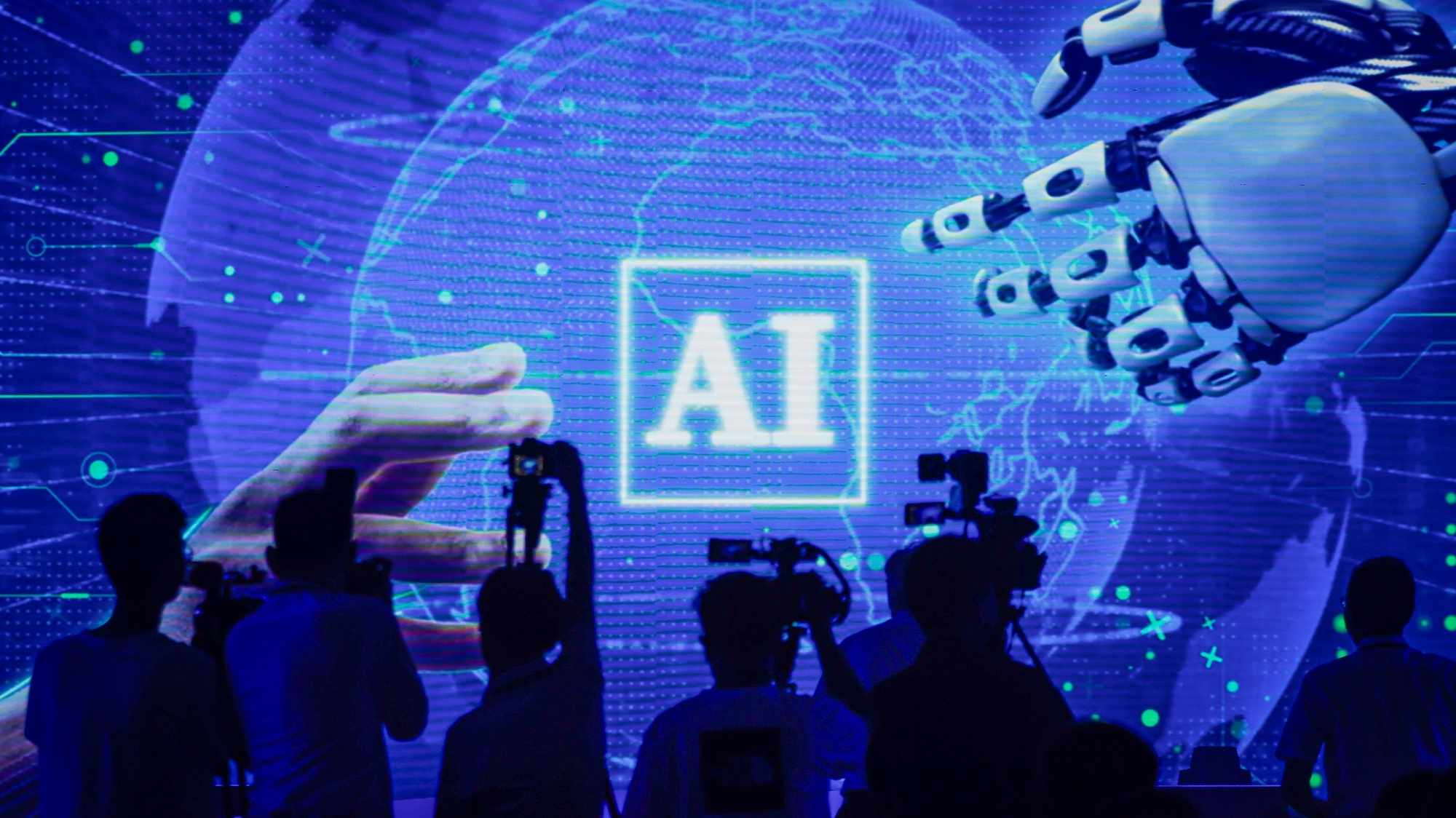

“A nossa nova abordagem de benchmark para MMLU permite que o Gemini utilize os seus recursos de raciocínio para pensar com mais cuidado antes de responder a perguntas difíceis, levando a melhorias significativas em relação ao uso apenas da sua primeira impressão”, acrescenta o mesmo responsável. Numa tabela partilhada pela Google, é percetível que foi feita a comparação entre o Gemini Ultra, a versão mais avançada, e o modelo GPT-4, desenvolvido pela OpenAI.

A tabela de comparação partilhada pela Google

O Gemini vai estar disponível em três tamanhos, “capaz de funcionar com eficiência em tudo, desde dispositivos móveis até data centers”, detalha a empresa. O Gemini Ultra é o modelo maior, destinado a tarefas altamente complexas, mas não está ainda disponível. O Gemini Pro será o adequado para “escalar uma gama alargada de tarefas”, enquanto a versão Nano estará destinada a tarefas em dispositivo.

Os programadores também vão ter um papel nos trabalhos do Gemini. A partir de 13 de dezembro, os programadores e clientes empresariais vão poder aceder ao Gemini Pro através da interface de programação de aplicações (API) Gemini no Google AI Studio ou em Google Cloud Vertex AI, indica a tecnológica.

[Já saiu: pode ouvir aqui o quinto episódio da série em podcast “O Encantador de Ricos”, que conta a história de Pedro Caldeira e de como o maior corretor da Bolsa portuguesa seduziu a alta sociedade. Pode ainda ouvir o primeiro episódio aqui, o segundo episódio aqui, o terceiro episódio aqui e o quarto episódio aqui.]

Gemini vai atualizar o Bard e até o Pixel 8 Pro vai usar modelo de IA

A presença do Gemini vai ser sentida já em alguns produtos do universo Google. Em março, a Google revelou o Bard, o seu chatbot para competir com o popular ChatGPT, que ficou disponível há um ano, acelerando a corrida da IA. Em julho, chegou a Portugal.

Bard, rival do ChatGPT desenvolvido pela Google, chega a Portugal

Agora, anuncia que este serviço de chatbot passará a usar uma versão “aprimorada” do Gemini Pro. Segundo a tecnológica, esta vai ser a “maior atualização” do chatbot desde que foi lançado. Por agora, só estará disponível em inglês, mas chega a mais de 170 países e territórios. A Google garante que tem planos para “expandir a diferentes modalidades, locais e idiomas” em breve.

O Pixel 8 Pro, o smartphone topo de gama da Google, que chegou em outubro a Portugal, também vai contar com o Gemini. O telemóvel vai usar a versão Gemini Nano, para poder resumir gravações na app Gravador ou melhorar a resposta inteligente no Gboard, o teclado da Google. Por agora, começará pela compatibilidade com o WhatsApp, mas deverá chegar a “mais aplicações de mensagens no próximo ano”.